段落文本 p演示代码

彩色文字在一段话中方便插入各种颜色的标签,包括:红色黄色绿色青色蓝色灰色

超大号文字文档「开始」页面中的标题部分就是超大号文字。超大号文字

小文字

- 彩色文字 在一段话中方便插入各种颜色的标签,包括:{% p red, 红色 %}{% p yellow, 黄色 %}{% p green, 绿色 %}{% p cyan, 青色 %}{% p blue, 蓝色 %}{% p gray, 灰色 %}- 超大号文字 文档「开始」页面中的标题部分就是超大号文字。 {% p center logo large, 超大号文字 %} {% p center small, 小文字 %}

行内文本 span演示代码

彩色文字在一段话中方便插入各种颜色的标签,包括:红色、黄色、绿色、青色、蓝色、灰色。

超大号文字文档「开始」页面中的标题部分就是超大号文字。VolantisA Wonderful Theme for H ...

Huggingface数据集以及模型使用注意:由于HuggingFace把数据集/模型存储在谷歌云盘上,在国内加载时可能会遇到网络问题,推荐国内镜像站

地址:https://hf-mirror.com/

Hugging Face CLI(命令行界面)

Hugging Face CLI(命令行界面)是一个工具,用于与Hugging Face模型和数据集的Hub进行交互。它提供了一种简单的方式来搜索、下载、上传、共享和管理模型、数据集以及其他相关资源。用户可以通过命令行轻松地访问Hugging Face生态系统中的各种模型和数据集,从而加快机器学习实验的速度并促进模型和数据的共享与合作。huggingface-cli 的优点包括:支持断点续传,避免因网络中断而导致的文件损坏。支持指定镜像 endpoint,可直接使用本站镜像服务。默认使用多文件并行下载,速度更快。(如需更极致的下载速度,可对文件链接用其他多线程下载工具下载,默认不推荐)支持 Gated model 下载 如 llama。–token参数,详见文档。支持 ...

window下安装并使用nvm(含卸载node、卸载nvm、全局安装npm)

nvm 全名 node.js version management,顾名思义是一个nodejs的版本管理工具。通过它可以安装和切换不同版本的nodejs。

卸载node如果你已经安装了node,那么你需要先卸载node,如果你没有安装那直接跳过这一步到下一步。

安装nvm去github 下载最新的 nvm 找到 nvm-setup.zip 点击下载

然后安装……

点击next,安装完成后在终端输入nvm version,能查到版本号说明安装成功了。

配置路径和下载源安装完nvm后先不要着急安装node。

找到nvm安装路径 -> 找到 settings.txt 文件 -> 配置下载源

以下为最新镜像源:

配置node镜像:

node_mirror: https://npmmirror.com/mirrors/node/

配置npm镜像:

npm_mirror: https://npmmirror.com/mirrors/npm/

使用nvm安装node在终端输入 nvm list avai ...

这一学期,这一年我做了些什么呢,在大一下学期我才认识到学习的意义,进步的意义,明白了大学不应浑浑噩噩的度过,生命不息,学习不止,我开始各种的比赛,努力的学习,从开始C语言都学不明白到现在认识到学习一门语言是比较简单的,难的是如何通过各种算法,思维去应用他们。我开始认识到,自己的专业是计算机,应向这方面去了解,这一年,我学习了Java,Python,Mysql,HTML,CSS,JavaScript,Linux等多种技术,有些只是入门级别,有些学习的较多,下面介绍一下本学年我的情况

关于学习人工智能本学年在项目组跟随阿凯科技的老师学习了人工智能的应用,主要为实战项目的学习.

阿凯科技:经营范围包括人工智能、云计算、计算机软硬件的技术研发、技术转让;信息技术咨询技术服务;数据处理与存储服务;互联网接入服务业务;计算机系统集成;设计、制作、代理国内广告业务,发布国内户外广告业务;企业管理咨询;计算机软件的网上销售;货物和技术的进出口业务,国家禁止和涉及行政审批的货物和技术的进出口除外;增值电信业务。

网络应用1.学习了线性回归、卷积神经网络(二分类、多分类)、迁移学习、多任务学习模型( ...

介绍此文仅介绍一些开源的、简单的、基于docker的一些比较好玩的项目

说在前面考完试后,因为无聊,想要整点活儿,闲来无事看到了阿里云价值61/年的服务器,直呼太香了,买买买

所谓,买都买了,不能让他闲着,直接安装了宝塔面板,开始造!

项目分享论坛最经典的论坛,没有之一,简单粗暴,一键部署

Discuz一键部署

vscode_web官方GitHub仓库)

我采用了拉取docker镜像的方式

一、拉取镜像

docker pull codercom/code-server

指令将从dockerhub上拉取code-server的最新版本

验证:查看镜像:

docker images

二、创建容器

docker run --name coder-server -p 8082:8080 -e PASSWORD=123 codercom/code-server:latest运行成功后,浏览器打开网址http://localhost:8082,弹出密码窗口输入123即可。

界面如下图所示:

镜像管理portainer是一款容器管理可视化界面,不想在虚拟中使用命令管理容器的小伙伴 ...

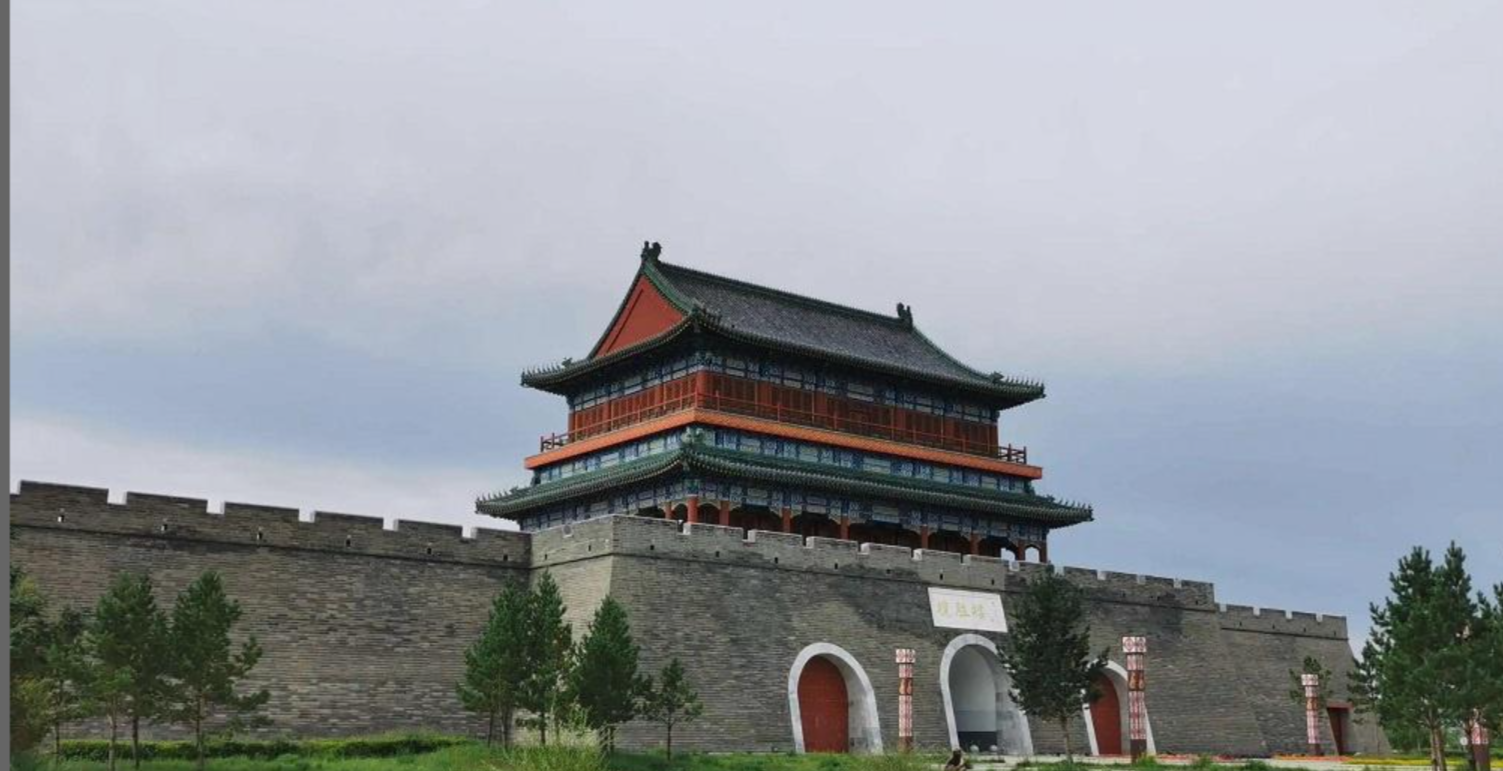

张北寻迹 传承文化

在这个世界上,没有别的东西比文化更难捉摸。我们不能分析它,因为它的成分无穷无尽;我们不能叙述它,因为它没有固定的形状。我们想用文字来定义它,这就像要把空气抓在手里:除了不在手里,它无处不在。——余秋雨

“北京的北,华北的北,河北的北方有个张北”。这是我们县最有名的歌曲《在张北》的歌词。文化寻根,我的家乡在张北,是河北省张家口市北方的一个边落小城,张北县,蒙原南,长城外,古道边,连大漠,接中原,历史久,四千年……”这是《张北县历史三字歌》开场的几句话。短短的24个字概述了张北县独特的区位、古朴的环境和悠久的历史。

文化史先有文明史, 民国版《张北县志》载:“约四千年前,张北一带已有人类活动, 先后出现鬼方等17个少数民族部落,在这里繁衍生息,为这里创建了早期文明。”燕、赵、秦、汉、北魏、明“六代长城”经由县境,这在全国200多个有长城的县中非常罕见。

家乡寻迹,传承文化,文化寻根,如何了解一座城的文化?比较接地气的方法就是通过街道的名称,这些街道名字的含义和背后的故事可以帮助我们更好地理解当地的历史和文化。张北城的街路之名,宛如这个城市的一张名片,凸显了它的历史底 ...

4C大赛

中国大学生计算机设计大赛(Chinese Collegiate Computing Competition,简称4C)

简介中国大学生计算机设计大赛是我国高校面向本科生最早的赛事之一,是全国普通高校大学生竞赛排行榜榜单赛事之一。

地位

截图来源

赛道2023年大赛分设11个大类

2022年大赛分设15个大类

2021年大赛分设16个大类

对于赛道,我们符合的大数据应用、软件应用与开发、人工智能应用、物联网应用……

参加大赛需要什么好的项目参加此类比赛,比如4C,互联网+,创新创业大赛……等比赛都需要一个好的项目,需要有足够的创新点,闪光点

实话说,没有创新点,或者创新点不够很难出校赛,更别提省赛之后的事情了

自身的能力

以我去年的经历,在C语言还没有学会的年级,就要开始面对人工智能导论,我真的会😅

第一次开组会,我在迷茫了一小时后,说了句,好高级😶

对于这个比赛,需要边参加边学习

如果是什么都会,然后参加,那感情好,你是佬,我只能说求带

如果是你什么都不会,那无话可说,我的建议是去学习吧

如果你,会一点,不全会,那没关系的,边学边做,用啥学啥� ...

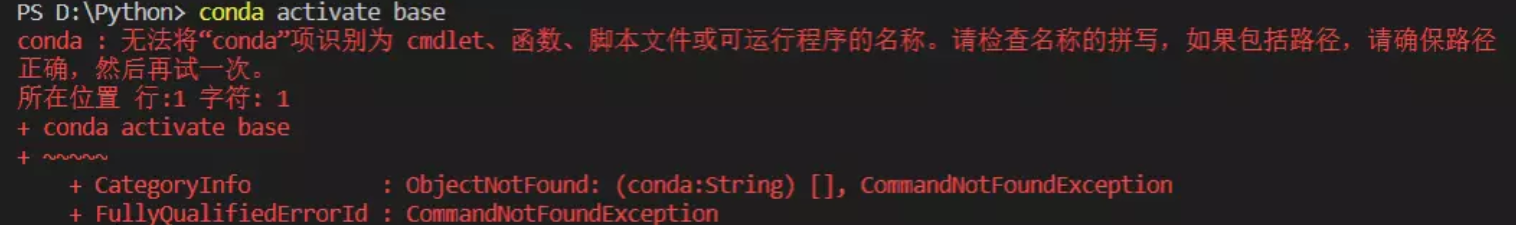

当我们在pycharm配置完成conda虚拟环境后,开始了漫长的学习……

😶😶😶

问题突然有一天,我们在pycharm里打开终端

跳出了如下的错误

坏!!!

怎么办???

问题原因没有添加系统变量,所以系统根本识别不了conda命令,找不到位置

解决办法当然是添加环境变量啦!!!

根据自己的anconda的位置,添加如下环境变量

``E:\anaconda\Library\bin`

E:\anaconda\Scripts

E:\anaconda

重启pycharm,解决!!!

编程语言的两大门派

众所周知✍️当下主流的编程语言分别为面向过程和面向对象

但是在过去的学习中,对于两者的区别🤖

面向对象的编程视频学习面向对象编程—先导篇

三要素:封装、继承、多态

封装封装表示写类的人将内部实现细节隐藏起来,使用类的人只通过外部接口访问和使用

在使用的情况下,我们只需要知道这个类里面有什么方法,方法有什么作用,方法怎么用

继承通过继承父类,减少属性、方法的重复定义,减少代码的冗余

多态同样的接口,因为对象具体类的不同而有不同的表现

对子类不适用于父类中的方法,进行单独定义,比如小学生和大学生的作业,因为难度的区别,不能在父类学生里定义,要在小学生、大学生里单独定义作业的方法。